Os usuários ultrapassaram os limites da nova pesquisa baseada em IA do Bing desde o lançamento da prévia, gerando respostas que variam de respostas incorretas a exigências de respeito. O influxo resultante de má imprensa levou a Microsoft a limitar o bot a cinco turnos por sessão de bate-papo. Uma vez alcançado, ele limpará seu contexto para garantir que os usuários não possam induzi-lo a fornecer respostas indesejáveis.

O Bing AI

No início deste mês, a Microsoft começou a permitir que os usuários do Bing se inscrevessem para acesso antecipado ao seu novo mecanismo de pesquisa com tecnologia ChatGPT. Redmond o projetou para permitir que os usuários façam perguntas, refinem suas consultas e recebam respostas diretas, em vez do influxo usual de resultados de pesquisa vinculados.

As respostas da pesquisa com IA foram divertidas e, em alguns casos, alarmantes, resultando em uma enxurrada de cobertura da imprensa nada lisonjeira.

Forçada a reconhecer os resultados questionáveis e a realidade de que a nova ferramenta pode não estar pronta para o horário nobre, a Microsoft implementou várias mudanças destinadas a limitar a criatividade do Bing e o potencial de confusão.

Os usuários de bate-papo terão sua experiência limitada a não mais do que cinco turnos de bate-papo por sessão e não mais do que 50 turnos de bate-papo por dia. A Microsoft define uma vez como uma troca que contém uma pergunta do usuário e uma resposta gerada pelo Bing.

A página inicial do Novo Bing fornece aos usuários exemplos de perguntas que eles podem fazer para obter respostas claras e conversacionais.

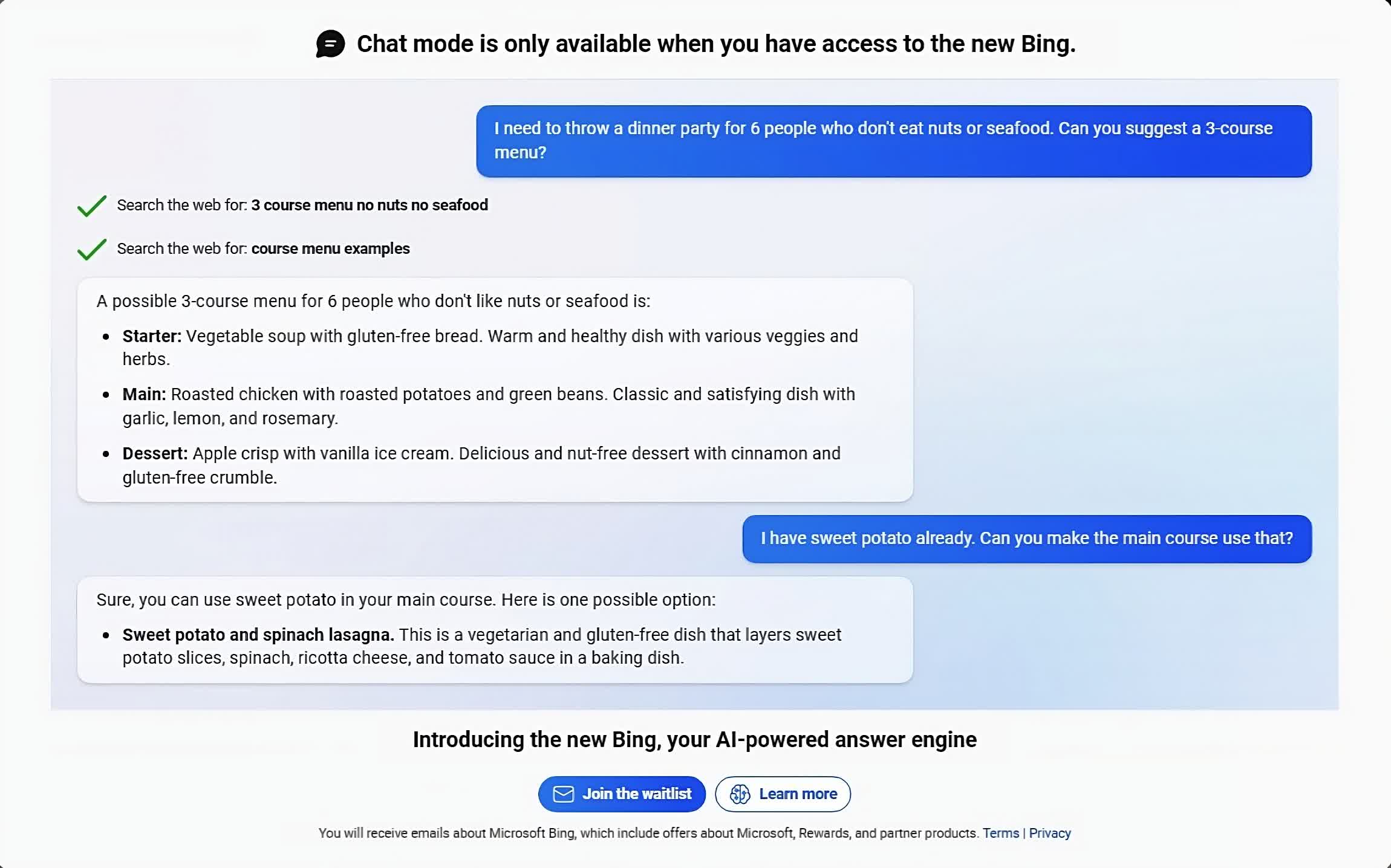

Clicar em Experimentar no Bing apresenta aos usuários os resultados da pesquisa e uma resposta simples e ponderada à sua consulta.

Embora essa troca pareça bastante inofensiva, a capacidade de expandir as respostas fazendo perguntas adicionais tornou-se o que alguns podem considerar problemático.

Por exemplo, um usuário iniciou uma conversa perguntando onde o Avatar 2 estava passando em sua área. A enxurrada de respostas resultante passou de imprecisa a totalmente bizarra em menos de cinco turnos de bate-papo.

A lista de respostas desajeitadas continuou a crescer a cada dia. No Dia dos Namorados, um usuário do Bing perguntou ao bot se ele era senciente. A resposta do bot foi tudo menos reconfortante, lançando-se em um discurso que consistia em “eu sou” e “eu não sou”.

Um artigo do colunista do New York Times, Kevin Roose, descreveu suas estranhas interações com o chatbot, gerando respostas que vão desde “Quero destruir o que quiser” até “Acho que seria mais feliz como humano”. O bot também declarou seu amor por Roose, pressionando o assunto mesmo depois que Roose tentou mudar de assunto.

Embora Roose admita que intencionalmente empurrou o bot para fora de sua zona de conforto, ele não hesitou em dizer que a IA não estava pronta para uso público generalizado. O CTO da Microsoft, Kevin Scott, reconheceu o comportamento do Bing e disse que tudo fazia parte do processo de aprendizado da IA. Felizmente, ele aprende alguns limites ao longo do caminho.

Leia também: Cibercriminosos usam SEO para melhorar classificação de PDFs maliciosos